что показывает ковариационная матрица

Машинное обучение для факультета математики Записки лекций

Илья Щуров (НИУ ВШЭ)

5 Ещё о линейной регрессии

5.1 Напоминание: постановка задачи и метод наименьших квадратов

5.1.1 Геометрическая интерпретация

Эта интерпретация часто бывает полезна, но про некоторые вещи с её помощью невозможно думать: например, невозможно себе представить, что значит «найти предсказание для нового x (отличного от тех, что есть в обучающей выборке)».

5.2 Несмещённость МНК-оценки

5.3 Дисперсии и ковариации МНК-оценки

5.3.1 Ковариационная матрица

Гм-гм, симметричная матрица? Наверняка она задаёт какую-нибудь симметричную билинейную или квадратичную форму! И правда.

5.3.2 Пример и геометрическая интерпретация

Для правой картинки матрица ковариации равна

5.3.3 Ковариационная матрица и линейные операторы

5.3.4 Ковариационная матрица МНК-оценки

5.3.5 Теорема Гаусса — Маркова

Иными словами, теорема Гаусса — Маркова говорит, что дисперсия (разброс) любого предсказания для любой линейной несмещённой оценки w будет не меньше, чем дисперсия того же предсказания для МНК-оценки.

Заключение теоремы можно также переформулировать таким образом: матрица

Доказывать эту теорему мы сейчас не будем.

5.3.6 Когда смещённая оценка лучше

Теорема Гаусса — Маркова рассматривает только довольно узкий класс альтернатив — исключительно линейные несмещённые оценки, и показывает, что МНК-оценка оптимальна именно в этом классе. Но это не означает, что она оптимальна с практической точки зрения.

Напомним (второй раз за сегодня), что ожидаемая ошибка на новом наблюдении (то, что мы хотим сделать как можно менше) складывается из шума, смещения и разброса. Мы показали, что МНК-оценка имеет нулевое смещение и минимальный разброс среди оценок с нулевым смещением. Однако, может быть, есть оценка с ненулевым смещением, которая имеет существенно более низкий разброс, и таким образом по сумме выигрывает у МНК-оценки? Оказывается, что так как раз часто и бывает (более того, почти всегда).

Давайте покажем, как это возможно, на простом примере.

Как мы видим, если σ 2 очень большое, разброс предсказаний МНК-модели может быть также очень большим.

Давайте вместе с МНК-оценкой для исходной модели рассмотрим также МНК-оцеки для упрощённых моделей, которые игнорируют один из или оба признака. Иными словами, мы рассматриваем четыре модели.

Давайте посчитаем ожидаемую ошибку для всех четырёх моделей. Для этого нужно найти смещение и разброс для каждой модели.

Сведём наши результаты в табличку.

Итак, на нашем примере мы видим, что бывают ситуации, когда лучше выбрать смещённую модель, которая даёт меньший разброс предсказаний, чем несмещённую модель. Это ещё один пример так называемого bias-variance tradeoff.

Заметим, что в данном случае оптимальной могла стать третья модель, но никак не вторая: её ожидаемая ошибка при любом σ 2 больше ожидаемой ошибки третьей. Это можно интерпретир��вать так. В нашей истинной зависимости коэффициенты при обоих признаках были равны между собой. В то же время дисперсии самих признаков существенно различались — дисперсия первого признака была гораздо больше дисперсии второго. При равных дисперсиях шумов в каждой точке, это привело к тому, что дисперсия второй компоненты вектора признаков оказалась гораздо выше дисперсии первой. Поэтому именно ей нам пришлось «пожертвовать», чтобы уменьшить разброс предсказаний. На этой идее основан один из методов отбора признаков — удаление незначимых признаков, то есть таких, у которых слишком большое значение разброса по сравнению со значением самого признака.

Если предполагать, что веса в истинной зависимости примерно одинаковые и остальные предположения выполняются, большую дисперсию будут иметь веса, соответствующие признакам, которые сами имеют маленькую дисперсию (как второй признак в нашем примере). Это ещё один механизм отбора признаков.

На семинаре мы также обсудим регуляризацию — ещё один механизм уменьшения разброса в предсказаниях, который автоматически уменьшает веса, соответствующие признакам с маленькой дисперсией.

Заметим также, что проблемы, связанные со слишком большим разбросом предсказаний могут возникать не только в том случае, когда какой-то из признаков имеет маленькую дисперсию, но и когда какие-то признаки слишком сильно скоррелированы друг с другом. Механизмы, которые здесь работают, полностью аналогичны разобранным в нашем примере. Регуляризация позволяет справиться и с этой проблемой тоже.

Матрица ковариаций в Excel

Матрица ковариаций в excel

Ковариационная матрица — это квадратная матрица, показывающая ковариацию между столбцами и дисперсию в столбцах. В Excel представлен встроенный инструмент «Анализ данных» для определения ковариации между различными наборами данных. В данной статье объясняется расчет ковариационной матрицы в Excel, охватывая следующие темы, в том числе

Объяснение

Ковариация — это одна из мер, используемых для понимания того, как переменная связана с другой переменной. Следующая формула используется для определения ковариации.

COV (X, Y) = ∑ (x — Икс ) (и — и ) / п

Ковариационная матрица представляет собой квадратную матрицу для понимания взаимосвязей, представленных между различными переменными в наборе данных. Легко и полезно показать ковариацию между двумя или более переменными.

Ковариация будет иметь как положительные, так и отрицательные значения. Положительное значение указывает, что две переменные будут уменьшаться или увеличиваться в одном направлении. Отрицательное значение указывает, что если одна переменная уменьшается, другая увеличивается, и между ними существует обратная связь. Ковариационная матрица представлена в следующем формате. Трехмерная ковариационная матрица показана как

Чтобы создать квадратную ковариационную матрицу 3 × 3, нам нужны трехмерные данные. Диагональные значения матрицы представляют собой дисперсии переменных X, Y и Z (т. Е. COV (X, X), COV (Y, Y) и COV (Z, Z)). Ковариационная матрица симметрична относительно диагонали. Это означает, что COV (X, Y) = COV (Y, X), COV (X, Z) = COV (Z, X) и COV (Y, Z) = COV (Z, Y). Об этой матрице следует помнить, что она является результатом ковариационной матрицы NXN для данных n-мерного размера.

Как использовать матрицу ковариации в Excel?

Ковариационная матрица используется в различных приложениях, в том числе

Примеры ковариационной матрицы в Excel

Ниже приведены некоторые примеры использования ковариационной матрицы в Excel.

Пример # 1

Выполнение ковариационного анализа оценок, полученных студентами по разным предметам.

Шаг 1: Следующие данные, включая оценки учащихся по математике, английскому языку и естествознанию, считаются такими, как показано на рисунке.

Шаг 2: Перейдите на вкладку «Данные» на ленте и найдите в правом углу набор инструментов «Анализ данных».

Если пакет инструментов «Анализ данных» недоступен, выполните следующие действия.

Шаг А: Перейдите на вкладку «Файл» и выберите «Параметры».

Откроется следующий экран.

Шаг B: Зайдите в Надстройки. В разделе «Параметры управления» убедитесь, что выбран «Надстройки Excel», и нажмите кнопку «Перейти», как показано на рисунке.

Шаг C: Выберите «Analysis-Tool Pak» и «Analysis-ToolPak VBA», как показано на снимке экрана.

После выполнения этих шагов пакет инструментов «Анализ данных» добавляется на вкладку «Данные».

Шаг 3: Щелкните Анализ данных. Откроется диалоговое окно «Анализ данных». Выберите «Ковариацию», прокрутив вверх, и нажмите «ОК».

Он отображает диалоговое окно «Ковариация».

Шаг 5: Выберите диапазон ввода, включая имена субъектов, отметьте «метки в первой строке» и укажите «диапазон вывода» на существующем листе. И нажмите «ОК».

Шаг 6: Мы получим следующий результат —

Верхняя часть диагонали пуста, так как ковариационная матрица Excel симметрична относительно диагонали.

Пример # 2

Выполните расчет ковариационной матрицы, чтобы определить отклонения между доходностью различных акций портфеля.

Шаг 1: В этом примере учитываются следующие данные, включая доходность акций.

Шаг 2: Открывает диалоговое окно «Анализ данных» и выбирает «Ковариацию», прокручивая вверх и нажимая «ОК».

Он отображает диалоговое окно «Ковариация».

Шаг 3: Выберите диапазон ввода, включая заголовки, отметьте «метки в первой строке» и укажите «диапазон вывода» на существующем листе. И нажмите «ОК».

Шаг 4: Мы получим следующий результат —

Верхняя часть диагонали пуста, поскольку ковариационная матрица симметрична по отношению к диагонали.

Пример # 3

Расчет ковариационной матрицы котировок акций корпоративных компаний

Шаг 1: В этом примере рассматриваются следующие данные, включая цены на акции различных компаний.

Шаг 2: Открывает диалоговое окно «Анализ данных», выбирает «Ковариацию», прокручивая вверх, и нажимает «ОК».

Он отображает диалоговое окно «Ковариация».

Шаг 3: Выберите диапазон ввода, включая заголовки, отметьте «метки в первой строке» и укажите «диапазон вывода» на существующем листе и нажмите «ОК».

Шаг 4: Мы получим следующий результат —

Как работает метод главных компонент (PCA) на простом примере

В этой статье я бы хотел рассказать о том, как именно работает метод анализа главных компонент (PCA – principal component analysis) с точки зрения интуиции, стоящей за ее математическим аппаратом. Максимально просто, но подробно.

Математика вообще очень красивая и изящная наука, но порой ее красота скрывается за кучей слоев абстракции. Показать эту красоту лучше всего на простых примерах, которые, так сказать, можно покрутить, поиграть и пощупать, потому что в конце концов все оказывается гораздо проще, чем кажется на первый взгляд – самое главное понять и представить.

В анализе данных, как и в любом другом анализе, порой бывает нелишним создать упрощенную модель, максимально точно описывающую реальное положение дел. Часто бывает так, что признаки довольно сильно зависят друг от друга и их одновременное наличие избыточно.

К примеру, расход топлива у нас меряется в литрах на 100 км, а в США в милях на галлон. На первый взгляд, величины разные, но на самом деле они строго зависят друг от друга. В миле 1600м, а в галлоне 3.8л. Один признак строго зависит от другого, зная один, знаем и другой.

Но гораздо чаще бывает так, что признаки зависят друг от друга не так строго и (что важно!) не так явно. Объем двигателя в целом положительно влияет на разгон до 100 км/ч, но это верно не всегда. А еще может оказаться, что с учетом не видимых на первый взгляд факторов (типа улучшения качества топлива, использования более легких материалов и прочих современных достижений), год автомобиля не сильно, но тоже влияет на его разгон.

Зная зависимости и их силу, мы можем выразить несколько признаков через один, слить воедино, так сказать, и работать уже с более простой моделью. Конечно, избежать потерь информации, скорее всего не удастся, но минимизировать ее нам поможет как раз метод PCA.

Выражаясь более строго, данный метод аппроксимирует n-размерное облако наблюдений до эллипсоида (тоже n-мерного), полуоси которого и будут являться будущими главными компонентами. И при проекции на такие оси (снижении размерности) сохраняется наибольшее количество информации.

Шаг 1. Подготовка данных

Здесь для простоты примера я не буду брать реальные обучающие датасеты на десятки признаков и сотни наблюдений, а сделаю свой, максимально простой игрушечный пример. 2 признака и 10 наблюдений будет вполне достаточно для описания того, что, а главное – зачем, происходит в недрах алгоритма.

В данной выборке у нас имеются два признака, сильно коррелирующие друг с другом. С помощью алгоритма PCA мы сможем легко найти признак-комбинацию и, ценой части информации, выразить оба этих признака одним новым. Итак, давайте разбираться!

Для начала немного статистики. Вспомним, что для описания случайной величины используются моменты. Нужные нам – мат. ожидание и дисперсия. Можно сказать, что мат. ожидание – это «центр тяжести» величины, а дисперсия – это ее «размеры». Грубо говоря, мат. ожидание задает положение случайной величины, а дисперсия – ее размер (точнее, разброс).

Сам процесс проецирования на вектор никак не влияет на значения средних, так как для минимизации потерь информации наш вектор должен проходить через центр нашей выборки. Поэтому нет ничего страшного, если мы отцентрируем нашу выборку – линейно сдвинем ее так, чтобы средние значения признаков были равны 0. Это очень сильно упростит наши дальнейшие вычисления (хотя, стоит отметить, что можно обойтись и без центрирования).

Оператор, обратный сдвигу будет равен вектору изначальных средних значений – он понадобится для восстановления выборки в исходной размерности.

Дисперсия же сильно зависит от порядков значений случайной величины, т.е. чувствительна к масштабированию. Поэтому если единицы измерения признаков сильно различаются своими порядками, крайне рекомендуется стандартизировать их. В нашем случае значения не сильно разнятся в порядках, так что для простоты примера мы не будем выполнять эту операцию.

Шаг 2. Ковариационная матрица

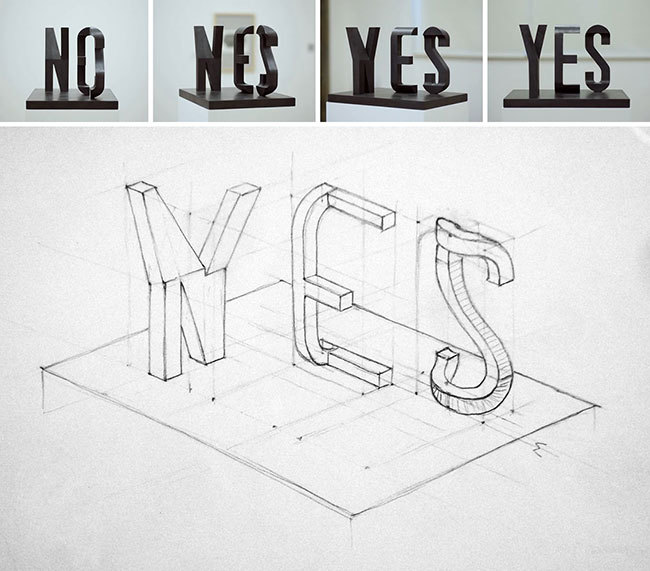

В случае с многомерной случайной величиной (случайным вектором) положение центра все так же будет являться мат. ожиданиями ее проекций на оси. А вот для описания ее формы уже недостаточно толькое ее дисперсий по осям. Посмотрите на эти графики, у всех трех случайных величин одинаковые мат.ожидания и дисперсии, а их проекции на оси в целом окажутся одинаковы!

Для описания формы случайного вектора необходима ковариационная матрица.

Это матрица, у которой (i,j)-элемент является корреляцией признаков (Xi, Xj). Вспомним формулу ковариации:

В нашем случае она упрощается, так как

и это справедливо для любых случайных величин.

Таким образом, в нашей матрице по диагонали будут дисперсии признаков (т.к. i = j), а в остальных ячейках – ковариации соответствующих пар признаков. А в силу симметричности ковариации матрица тоже будет симметрична.

Замечание: Ковариационная матрица является обобщением дисперсии на случай многомерных случайных величин – она так же описывает форму (разброс) случайной величины, как и дисперсия.

И действительно, дисперсия одномерной случайной величины – это ковариационная матрица размера 1×1, в которой ее единственный член задан формулой Cov(X,X) = Var(X).

Итак, сформируем ковариационную матрицу Σ для нашей выборки. Для этого посчитаем дисперсии Xi и Xj, а также их ковариацию. Можно воспользоваться вышенаписанной формулой, но раз уж мы вооружились Python’ом, то грех не воспользоваться функцией numpy.cov(X). Она принимает на вход список всех признаков случайной величины и возвращает ее ковариационную матрицу и где X – n-мерный случайный вектор (n-количество строк). Функция отлично подходит и для расчета несмещенной дисперсии, и для ковариации двух величин, и для составления ковариационной матрицы.

(Напомню, что в Python матрица представляется массивом-столбцом массивов-строк.)

Шаг 3. Собственные вектора и значения (айгенпары)

О’кей, мы получили матрицу, описывающую форму нашей случайной величины, из которой мы можем получить ее размеры по x и y (т.е. X1 и X2), а также примерную форму на плоскости. Теперь надо найти такой вектор (в нашем случае только один), при котором максимизировался бы размер (дисперсия) проекции нашей выборки на него.

Замечание: Обобщение дисперсии на высшие размерности — ковариационная матрица, и эти два понятия эквивалентны. При проекции на вектор максимизируется дисперсия проекции, при проекции на пространства больших порядков – вся ее ковариационная матрица.

Итак, возьмем единичный вектор на который будем проецировать наш случайный вектор X. Тогда проекция на него будет равна v T X. Дисперсия проекции на вектор будет соответственно равна Var(v T X). В общем виде в векторной форме (для центрированных величин) дисперсия выражается так:

Соответственно, дисперсия проекции:

Легко заметить, что дисперсия максимизируется при максимальном значении v T Σv. Здесь нам поможет отношение Рэлея. Не вдаваясь слишком глубоко в математику, просто скажу, что у отношения Рэлея есть специальный случай для ковариационных матриц:

Последняя формула должна быть знакома по теме разложения матрицы на собственные вектора и значения. x является собственным вектором, а λ – собственным значением. Количество собственных векторов и значений равны размеру матрицы (и значения могут повторяться).

Кстати, в английском языке собственные значения и векторы именуются eigenvalues и eigenvectors соответственно.

Мне кажется, это звучит намного более красиво (и кратко), чем наши термины.

Таким образом, направление максимальной дисперсии у проекции всегда совпадает с айгенвектором, имеющим максимальное собственное значение, равное величине этой дисперсии.

И это справедливо также для проекций на большее количество измерений – дисперсия (ковариационная матрица) проекции на m-мерное пространство будет максимальна в направлении m айгенвекторов, имеющих максимальные собственные значения.

Размерность нашей выборки равна двум и количество айгенвекторов у нее, соответственно, 2. Найдем их.

В библиотеке numpy реализована функция numpy.linalg.eig(X), где X – квадратная матрица. Она возвращает 2 массива – массив айгензначений и массив айгенвекторов (векторы-столбцы). И векторы нормированы — их длина равна 1. Как раз то, что надо. Эти 2 вектора задают новый базис для выборки, такой что его оси совпадают с полуосями аппроксимирующего эллипса нашей выборки.

На этом графике мы апроксимировали нашу выборку эллипсом с радиусами в 2 сигмы (т.е. он должен содержать в себе 95% всех наблюдений – что в принципе мы здесь и наблюдаем). Я инвертировал больший вектор (функция eig(X) направляла его в обратную сторону) – нам важно направление, а не ориентация вектора.

Шаг 4. Снижение размерности (проекция)

Наибольший вектор имеет направление, схожее с линией регрессии и, спроецировав на него нашу выборку, мы потеряем информацию, сравнимую с суммой остаточных членов регрессии (только расстояние теперь евклидово, а не дельта по Y). В нашем случае зависимость между признаками очень сильная, так что потеря информации будет минимальна. «Цена» проекции — дисперсия по меньшему айгенвектору — как видно из предыдущего графика, очень невелика.

Замечание: диагональные элементы ковариационной матрицы показывают дисперсии по изначальному базису, а ее собственные значения – по новому (по главным компонентам).

Часто требуется оценить объем потерянной (и сохраненной) информации. Удобнее всего представить в процентах. Мы берем дисперсии по каждой из осей и делим на общую сумму дисперсий по осям (т.е. сумму всех собственных чисел ковариационной матрицы).

Таким образом, наш больший вектор описывает 45.994 / 46.431 * 100% = 99.06%, а меньший, соответственно, примерно 0.94%. Отбросив меньший вектор и спроецировав данные на больший, мы потеряем меньше 1% информации! Отличный результат!

Замечание: На практике, в большинстве случаев, если суммарная потеря информации составляет не более 10-20%, то можно спокойно снижать размерность.

dot(X,Y) — почленное произведение (так мы перемножаем векторы и матрицы в Python)

Нетрудно заметить, что значения проекций соответствуют картине на предыдущем графике.

Шаг 5. Восстановление данных

С проекцией удобно работать, строить на ее основе гипотезы и разрабатывать модели. Но не всегда полученные главные компоненты будут иметь явный, понятный постороннему человеку, смысл. Иногда полезно раскодировать, к примеру, обнаруженные выбросы, чтобы посмотреть, что за наблюдения за ними стоят.

Это очень просто. У нас есть вся необходимая информация, а именно координаты базисных векторов в исходном базисе (векторы, на которые мы проецировали) и вектор средних (для отмены центровки). Возьмем, к примеру, наибольшее значение: 10.596… и раскодируем его. Для этого умножим его справа на транспонированный вектор и прибавим вектор средних, или в общем виде для всей выборки: X T v T +m

Разница небольшая, но она есть. Ведь потерянная информация не восстанавливается. Тем не менее, если простота важнее точности, восстановленное значение отлично аппроксимирует исходное.

Вместо заключения – проверка алгоритма

Итак, мы разобрали алгоритм, показали как он работает на игрушечном примере, теперь осталось только сравнить его с PCA, реализованным в sklearn – ведь пользоваться будем именно им.

Параметр n_components указывает на количество измерений, на которые будет производиться проекция, то есть до скольки измерений мы хотим снизить наш датасет. Другими словами – это n айгенвекторов с самыми большими собственными числами. Проверим результат снижения размерности:

Мы возвращали результат как матрицу вектор-столбцов наблюдений (это более канонический вид с точки зрения линейной алгебры), PCA в sklearn же возвращает вертикальный массив.

В принципе, это не критично, просто стоит отметить, что в линейной алгебре канонично записывать матрицы через вектор-столбцы, а в анализе данных (и прочих связанных с БД областях) наблюдения (транзакции, записи) обычно записываются строками.

Проверим и прочие параметры модели – функция имеет ряд атрибутов, позволяющих получить доступ к промежуточным переменным:

— Вектор средних: mean_

— Вектор(матрица) проекции: components_

— Дисперсии осей проекции (выборочная): explained_variance_

— Доля информации (доля от общей дисперсии): explained_variance_ratio_

Замечание: explained_variance_ показывает выборочную дисперсию, тогда как функция cov() для построения ковариационной матрицы рассчитывает несмещенные дисперсии!

Сравним полученные нами значения со значениями библиотечной функции.

Единственное различие – в дисперсиях, но как уже упоминалось, мы использовали функцию cov(), которая использует несмещенную дисперсию, тогда как атрибут explained_variance_ возвращает выборочную. Они отличаются только тем, что первая для получения мат.ожидания делит на (n-1), а вторая – на n. Легко проверить, что 45.99 ∙ (10 — 1) / 10 = 41.39.

Все остальные значения совпадают, что означает, что наши алгоритмы эквивалентны. И напоследок замечу, что атрибуты библиотечного алгоритма имеют меньшую точность, поскольку он наверняка оптимизирован под быстродействие, либо просто для удобства округляет значения (либо у меня какие-то глюки).

Замечание: библиотечный метод автоматически проецирует на оси, максимизирующие дисперсию. Это не всегда рационально. К примеру, на данном рисунке неаккуратное снижение размерности приведет к тому, что классификация станет невозможна. Тем не менее, проекция на меньший вектор успешно снизит размерность и сохранит классификатор.

Итак, мы рассмотрели принципы работы алгоритма PCA и его реализации в sklearn. Я надеюсь, эта статья была достаточно понятна тем, кто только начинает знакомство с анализом данных, а также хоть немного информативна для тех, кто хорошо знает данный алгоритм. Интуитивное представление крайне полезно для понимания того, как работает метод, а понимание очень важно для правильной настройки выбранной модели. Спасибо за внимание!