Что измеряет прагматическая мера информации

Прагматическая мера информации

Эта мера определяет полезность информации (ценность) для достижения пользователем поставленной цели. Эта мера также величина относительная, обусловленная особенностями использования этой информации в той или иной системе. Ценность информации целесообразно измерять в тех же самых единицах (или близких к ним), в которых измеряется целевая функция.

Пример 2.5. В экономической системе прагматические свойства (ценность) информации можно определить приростом экономического эффекта функционирования, достигнутым благодаря использованию этой информации для управления системой:

где

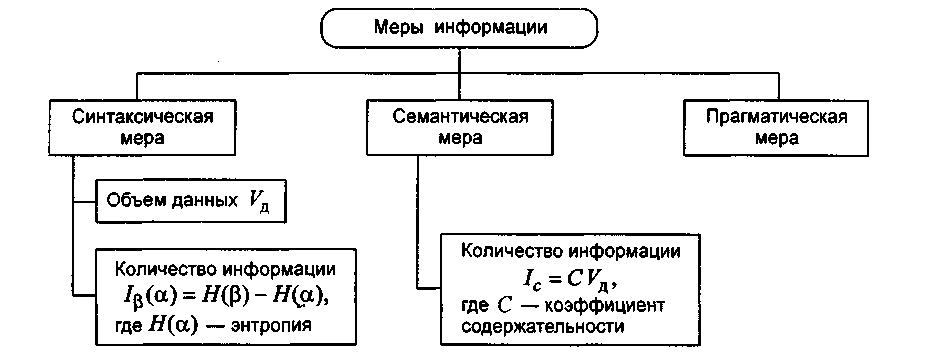

Для сопоставления введенные меры информации представим в табл. 2.1.

Таблица 2.1. Единицы измерения информации и примеры

| Мера информации | Единицы измерения | Примеры (для компьютерной области) |

| Синтаксическая: шенноновский подход компьютерный подход | Степень уменьшения неопределенности Единицы представления информации | Вероятность события Бит, байт, Кбайт и т.д. |

| Семантическая | Тезаурус Экономические показатели | Пакет прикладных программ, персональный компьютер, компьютерные сети и т.д. Рентабельность, производительность, коэффициент амортизации и т.д. |

| Прагматическая | Ценность использования | Емкость памяти, производительность компьютера, скорость передачи данных и т.д. Денежное выражение Время обработки информации и принятия решений |

КАЧЕСТВО ИНФОРМАЦИИ

Возможность и эффективность использования информации обусловливаются такими основными ее потребительскими показателями качества, как репрезентативность, содержательность, достаточность, доступность, актуальность, своевременность, точность, достоверность, устойчивость.

Репрезентативность информации связана с правильностью ее отбора и формирования в целях адекватного отражения свойств объекта. Важнейшее значение здесь имеют:

§ правильность концепции, на базе которой сформулировано исходное понятие;

§ обоснованность отбора существенных признаков и связей отображаемого явления.

Нарушение репрезентативности информации приводит нередко к существенным ее погрешностям.

Содержательность информации отражает семантическую емкость, равную отношению количества семантической информации в сообщении к объему обрабатываемых данных, т.е.

С увеличением содержательности информации растет семантическая пропускная способность информационной системы, так как для получения одних и тех же сведений требуется преобразовать меньший объем данных.

Наряду с коэффициентом содержательности С, отражающим семантический аспект, можно использовать и коэффициент информативности, характеризующийся отношением количества синтаксической информации (по Шеннону) к объему данных

Достаточность (полнота) информации означает, что она содержит минимальный, но достаточный для принятия правильного решения состав (набор показателей). Понятие полноты информации связано с ее смысловым содержанием (семантикой) и прагматикой. Как неполная, т.е. недостаточная для принятия правильного решения, так и избыточная информация снижает эффективность принимаемых пользователем решений.

Доступность информации восприятию пользователя обеспечивается выполнением соответствующих процедур ее получения и преобразования. Например, в информационной системе информация преобразовывается к доступной и удобной для восприятия пользователя форме. Это достигается, в частности, и путем согласования ее семантической формы с тезаурусом пользователя.

Актуальность информации определяется степенью сохранения ценности информации для управления в момент ее использования и зависит от динамики изменения ее характеристик и от интервала времени, прошедшего с момента возникновения данной информации.

Своевременность информации означает ее поступление не позже заранее назначенного момента времени, согласованного с временем решения поставленной задачи.

Точность информации определяется степенью близости получаемой информации к реальному состоянию объекта, процесса, явления и т.п. Для информации, отображаемой цифровым кодом, известны четыре классификационных понятия точности:

§ формальная точность, измеряемая значением единицы младшего разряда числа;

§ реальная точность, определяемая значением единицы последнего разряда числа, верность которого гарантируется;

§ максимальная точность, которую можно получить в конкретных условиях функционирования системы;

§ необходимая точность, определяемая функциональным назначением показателя.

Достоверность информации определяется ее свойством отражать реально существующие объекты с необходимой точностью. Измеряется достоверность информации доверительной вероятностью необходимой точности, т.е. вероятностью того, что отображаемое информацией значение параметра отличается от истинного значения этого параметра в пределах необходимой точности.

Устойчивость информации отражает ее способность реагировать на изменения исходных данных без нарушения необходимой точности. Устойчивость информации, как и репрезентативность, обусловлена выбранной методикой ее отбора и формирования.

В заключение следует отметить, что такие параметры качества информации, как репрезентативность, содержательность, достаточность, доступность, устойчивость, целиком определяются на методическом уровне разработки информационных систем. Параметры актуальности, своевременности, точности и достоверности обусловливаются в большей степени также на методическом уровне, однако на их величину существенно влияет и характер функционирования системы, в первую очередь ее надежность. При этом параметры актуальности и точности жестко связаны соответственно с параметрами своевременности и достоверности.

Прагматическая мера информации

Эта мера определяет полезность информации (ценность) для достижения пользователем поставленной цели. Эта мера также величина относительная, обусловленная особенностями использования этой информации в той или иной системе. Ценность информации целесообразно измерять в тех же самых единицах (или близких к ним), в которых измеряется целевая функция. С позиции каждого отдельного человека количество информации, содержащееся в каком-либо сообщении, — субъективная величина.

Объективная количественная мера информаций может быть введена на основе вероятностной трактовки информационного обмена.

Этот способ измерения количества информации впервые предложил в 1948 г. К. Шеннон. По К. Шеннону, информация — это сведения, уменьшающие неопределенность (энтропию), существовавшую до их получения.

Один бит информации получает человек, когда он узнает, опаздывает с прибытием нужный ему поезд или нет, был ночью мороз или нет, присутствует на лекции студент Иванов или нет и т. д.

Более крупная единица информации — байт — равна 8 бит. Проверка присутствия или отсутствия на лекции 24 студентов дает лектору три байта информации.

Еще более крупная единица информации 1 Кбайт — равна 1024 байт. далее — 1 Мбайт равен 1024 Кбайт, 1 Гбайт равен 1024 Мбайт, 1 Тбайт равен 1024 Гбайт, а 1 Пбайт равен 1024 Тбайт.

1.2.3 Системы кодирования информации. Показатели качества

информации.

Системы кодирования информации.

ASCII (англ. American Standard Code for Information Interchange) — американский стандартный код для обмена информацией. ASCII представляет собой кодировку для представления десятичных цифр, латинского и национального алфавитов, знаков препинания и управляющих символов. 2^8= 256

Юнико́д или Унико́д (англ. Unicode) — стандарт кодирования символов, позволяющий представить знаки практически всех письменных языков. Стандарт предложен в 1991 году некоммерческой организацией «Консорциум Юникода» (англ. Unicode Consortium, Unicode Inc.). Применение этого стандарта позволяет закодировать очень большое число символов из разных письменностей: в документах Unicode могут соседствовать китайские иероглифы, математические символы, буквы греческого алфавита, латиницы и кириллицы, при этом становится ненужным переключение кодовых страниц. Коды в стандарте Юникод разделены на несколько областей. Область с кодами от U+0000 до U+007F содержит символы набора ASCII с соответствующими кодами. Далее расположены области знаков различных письменностей, знаки пунктуации и технические символы. Часть кодов зарезервирована для использования в будущем

Advanced Vector Extensions (AVX) — расширение системы команд x86 для микропроцессоров Intel и AMD, предложенное Intel в марте 2008. AVX предоставляет различные улучшения, новые инструкции и новую схему кодирования машинных кодов. Подходит для интенсивных вычислений с плавающей точкой в мультимедиа, научных и финансовых задачах.

Показатели качества информации:

Репрезентативность информации – информация связана с правильностью её отбора и формирования в целях адекватного отражения свойств объекта.

Содержательность – отражает семантическую емкость, равную отношению количества семантической информации в сообщении к объему обрабатываемых данных С= Ic / Vd.

Достаточность (полнота) – означает что информация содержит минимальный но достаточный для принятия правильного решения состав (набор показателей)

Доступность – информации восприятию пользователя обеспечивается выполнение соответствующих процедур её получения и преобразования.

Актуальность информации определяется степенью сохранения ценности информации для управления в момент её использования.

Своевременность – означает её поступление не позже заранее назначенного момента времени, согласованного с временем поставленной задачи.

Точность – определяется степенью близости получаемой информации к реальному состоянию объекта, процесса, явления..

Устойчивость – отражает её способность реагировать на изменения исходных данных без нарушения точности.

Электронная библиотека

Кроме перечисленных уровней рассмотрения понятия информации широко используется прагматический уровень. На данном уровне информация рассматривается с точки зрения ее полезности (ценности) для достижения потребителем информации (человеком) поставленной практической цели. Данный подход при определении полезности информации основан на расчете приращения вероятности достижения цели до и после получения информации. Количество информации, определяющее ее ценность (полезность), находится по формуле:

где Р0, P1 – вероятность достижения цели соответственно до и после получения информации.

В качестве единицы измерения (меры) количества информации, определяющей ее ценность, может быть принят 1 бит (при основании логарифма, равном 2), т. е. такое количество полученной информации, при котором отношение вероятностей достижения цели равно 2.

Рассмотрим три случая, когда количество информации, определяющее ее ценность, равно нулю и когда она принимает положительное и отрицательное значение:

1) количество информации равно нулю при Р0 = Р1, т.е. полученная информация не увеличивает и не уменьшает вероятность достижения цели;

2) значение информации является положительной величиной при P1 > P0, т. е. полученная информация уменьшает исходную неопределенность и увеличивает вероятность достижения цели;

3) значение информации является отрицательной величиной при P1 Срочно?

Закажи у профессионала, через форму заявки

8 (800) 100-77-13 с 7.00 до 22.00

Прагматическая мера информации

Эта мера определяет полезность информации (ценность) для достижения пользователем поставленной цели. Эта мера также величина относительная, обусловленная особенностями использования информации в той или иной системе. Ценность информации целесообразно измерять в тех же самых единицах (или близких к ним), в которых измеряется целевая функция.

Для сопоставления введенные меры информации представим в табл. 2.1.

Таблица 2.1. Единицы измерения информации и примеры

| Мера информации | Единицы измерения | Примеры (для компьютерной области) |

| Синтаксическая: шенноновский подход компьютерный подход | Степень уменьшения неопределенности | Вероятность события |

| Единицы представления информации | Бит, байт, Кбайт и т.д. | |

| Семантическая | Тезаурус | Пакет прикладных программ, персональный компьютер, компьютерные сети и т.д. |

| Экономические показатели | Рентабельность, производительность, коэффициент амортизации и т.д. | |

| Прагматическая | Ценность использования | Денежное выражение |

| Емкость памяти, производительность компьютера, скорость передачи данных и т.д. | Время обработки информации и принятия решений |

Бит, байт и производные от них единицы

Для измерения количества информации нужна единица измерения.

В качестве единицы информации К. Шеннон предложил принять такое количество информации, при котором неопределенность уменьшается в 2 раза. Такая единица названа бит (англ. bit — binary digit — двоичная цифра).

Бит в теории информации — количество информации, необходимое для различения двух равновероятных сообщений (типа «орел – решка», «чет – нечет» и т.п.).

В вычислительной технике битом называют наименьшую «порцию» памяти компьютера, необходимую для хранения одного из двух знаков «0» и «1», используемых для внутримашинного представления данных и команд.

Информационный объем сообщения — количество двоичных символов, используемое для кодирования этого сообщения.

Бит — слишком мелкая единица измерения. На практике чаще применяется более крупная единица — байт, равная 8 бит. Именно 8 бит требуется для того, чтобы закодировать любой из 256 символов алфавита клавиатуры компьютера (256 = 2 8 ).

1 байт = 8 бит

Широко используются также еще более крупные производные единицы информации:

1 килобайт (Кбайт) = 1024 байт = 2 10 байт;

1 мегабайт (Мбайт) = 1024 Кбайт = 2 20 байт;

1 гигабайт (Гбайт) = 1024 Мбайт = 2 30 байт.

В последнее время в связи с увеличением объёмов обрабатываемой информации входят в употребление такие производные единицы, как:

1 терабайт (Тбайт) = 1024 Гбайт = 2 40 байт;

1 петабайт (Пбайт) = 1024 Тбайт = 2 50 байт.

Контрольные вопросы и задания

1. Как измеряется семантическая мера?

2. В чем суть прагматической меры информации?

3. Как измеряется объем данных?

4. Что такое энтропия?

5. Как оценить информацию с помощью формулы Хартли?

6. Как оценить информацию с помощью формулы Шеннона?

7. Назовите основные формы адекватности информации.

9. Чему равен 1 байт?

10. Назовите основные единицы измерения информации.

3. Системы счисления

Дата добавления: 2019-10-16 ; просмотров: 461 ; ЗАКАЗАТЬ НАПИСАНИЕ РАБОТЫ

Что измеряет прагматическая мера информации

Классификация мер

Для измерения информации вводятся два параметра: количество информации I и объем данных VД.

Эти параметры имеют разные выражения и интерпретацию в зависимости от рассматриваемой формы адекватности. Каждой форме адекватности соответствует своя мера количества информации и объема данных (рис. 2.1).

Рис. 2.1. Меры информации

Синтаксическая мера информации

Эта мера количества информации оперирует с обезличенной информацией, не выражающей смыслового отношения к объекту.

Объем данных VД в сообщении измеряется количеством символов (разрядов) в этом сообщении. В различных системах счисления один разряд имеет различный вес и соответственно меняется единица измерения данных:

• в двоичной системе счисления единица измерения — бит (bit — binary digit — двоичный разряд);

Примечание. В современных ЭВМ наряду с минимальной единицей измерения данных «бит» широко используется укрупненная единица измерения «байт», равная 8 бит.

• в десятичной системе счисления единица измерения — дат (десятичный разряд).

Пример 2.3. Сообщение в двоичной системе в виде восьмиразрядного двоичного кода 10111011 имеет объем данных VД = 8 бит.

Сообщение в десятичной системе в виде шестиразрядного числа 275903 имеет объем данных VД = 6 дит.

Количество информации I на синтаксическом уровне невозможно определить без рассмотрения понятия неопределенности состояния системы (энтропии системы). Действительно, получение информации о какой-либо системе всегда связано с изменением степени неосведомленности получателя о состоянии этой системы. Рассмотрим это понятие.

Пусть до получения информации потребитель имеет некоторые предварительные (априорные) сведения о системе α. Мерой его неосведомленности о системе является функция H(α), которая в то же время служит и мерой неопределенности состояния системы.

После получения некоторого сообщения β получатель приобрел некоторую дополнительную информацию Iβ(α), уменьшившую его априорную неосведомленность так, что апостериорная (после получения сообщения β) неопределенность состояния системы стала Hβ(α).

Тогда количество информации Iβ(α) о системе, полученной в сообщении β, определится как

т.е. количество информации измеряется изменением (уменьшением) неопределенности состояния системы.

Если конечная неопределенность Hβ(α) обратится в нуль, то первоначальное неполное знание заменится полным знанием и количество информации Iβ(α) = H(α). Иными словами, энтропия системы H(α) может рассматриваться как мера недостающей информации.

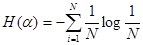

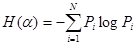

Энтропия системы H(α), имеющая N возможных состояний, согласно формуле Шеннона, равна:

где pi — вероятность того, что система находится в i-м состоянии.

Дня случая, когда все состояния системы равновероятны, т.е. их вероятности равны Pi =

Часто информация кодируется числовыми кодами в той или иной системе счисления, особенно это актуально при представлении информации в компьютере. Естественно, что одно и то же количество разрядов в разных системах счисления может передать разное число состояний отображаемого объекта, что можно представить в виде соотношения

где N — число всевозможных отображаемых состояний;

т — основание системы счисления (разнообразие символов, применяемых в алфавите); п — число разрядов (символов) в сообщении.