генеративные модели машинное обучение

Порождающие модели

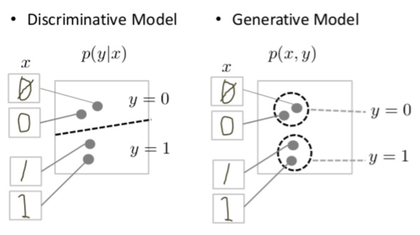

С другой стороны, дискриминативная модель (англ. discriminative model) [2] обучает только условное распределение и может, например, отличить собаку от кошки.

Примером простейшей порождающей модели является наивный байесовский классификатор.

Содержание

Классификация задачи [ править ]

Можно использовать некоторые эмпирические правила для генерации новых объектов, не используя машинного обучения.

Мы хотим научиться создавать правдоподобный объект относительно некоторой скрытой структуры исходных объектов. Давайте изучим распределение по ним, а затем просто будем сэмплировать новый объект из этого распределения. Значит эта задача относится к классу задач обучения без учителя.

Вычисление плотности распределения [ править ]

[math]\theta^* = \underset<\theta><\operatorname

[math]KL(\hat

_(x), p(x; \theta)) = \int \hat

_(x) \log p(x; \theta) = \displaystyle \sum_i \hat

_(x_i) \log p(x_i; \theta)[/math]

и минимизация этого выражения эквивалентна максимизации того, что выше.

Таксономия порождающих моделей [ править ]

Явный подход [ править ]

Можно строить это распределение явно, делая вероятностные предположения, которые обычно сводятся к тому, что общее распределение [math]p(x; \theta)[/math] выражается в виде произведения тех или иных распределений.

Как правило, модели, где плотность известна явно, делают какие-то дополнительные предположения на структуру этих распределений.

Например, байесовские сети строят распределение из условных распределений [math]\mathrm P(X_1, \ldots, X_n) = \prod_

Можно даже и вовсе никаких предположений не делать: любое распределение всегда раскладывается как:

[math]p(x) = \displaystyle \prod_ p(x_i \mid x_1, <<. >>, x_

WaveNet меняет парадигму, генерируя звуковой сигнал по семплам. Это не только приводит к более натуральному звучанию речи, но и позволяет создавать любые звуки, включая музыку. Эта архитектура состоит из нескольких последовательных слоев разреженных сверток и в ней снова встречаются остаточные связи, связи «через уровень» и так далее. Во время обучения входящие последовательности представляют собой звуковые волны от примеров записи голоса. После тренировки можно с помощью сети генерировать синтетические фразы. На каждом шагу семплирования значение вычисляется из вероятностного распределения, посчитанного сетью. Затем это значение возвращается на вход и делается новое предсказание для следующего шага.

В моделях PixelRNN [на 24.02.20 не создан] и PixelCNN [на 24.02.20 не создан] строится изображение пиксель за пикселем, слева направо и сверху вниз. Каждый пиксель [math]x_n[/math] порождается из условного распределения [math]p(x_n \mid x_1, <<. >>, x_

Модель DRAW [9] последовательно «рисует» картинку с помощью рекуррентной сети, а механизм внимания [на 24.02.20 не создан] помогает сети в данный момент сконцентрироваться на нужной части изображения.

Если хочется явно выразить совсем сложные распределения в порождающих моделях, их приходится приближать более простыми, которые уже, в свою очередь, могут быть выражены явно. Для этого обычно используются вариационные методы.

Неявный подход [ править ]

Генеративное глубокое обучение: давайте посмотрим, как ИИ расширяет, а не заменяет творческий процесс

Дата публикации Sep 15, 2018

«Технология не должна быть направлена на то, чтобы заменить людей, а скорее усиливать человеческие возможности».

— Дуг Энгельбарт, изобретатель компьютерной мыши

На Web Summit 2017, крупнейшей в мире технологической конференции в Лиссабоне, Португалия. София, человекоподобный робот, работающий на искусственном интеллекте (AI), сказала«Мы возьмем вашу работу»а аудитория 60 000 мировых технологических лидеров просто нервно рассмеялась.

До этого момента вы, наверное, все слышали о том, как достижения в области искусственного интеллекта наносят ущерб отраслям и создают угрозу безопасности рабочих мест для миллионов работников во всем мире. Рабочие места офисных служащих, администраторов, представителей обслуживания клиентов, аналитиков, маркетологов, врачей и адвокатов могут бытьзамененыИИ в следующем десятилетии. КакСундар ПичаиГенеральный директор Google сказал: «В ближайшие 10 лет мы перейдем к миру, в котором искусственный интеллект будет первым».

В этой статье я предоставлю обзор высокого уровня того, как ИИ используется в настоящее время для расширения, а не для замены, творческого процесса посредством глубокого обучения.

В этом посте я расскажу, что такое генеративное глубокое обучение, что такое Discriminativeмодель и чем она отличается от Generativeмодель. Я даже приведу несколько конкретных примеров применения генеративного глубокого обучения, которое в дальнейшем поможет всем и каждому расширить свое понимание фантастических возможностей, которые эти Генеративные модели предлагают всем нам.

Итак, переведите свой мобильный телефон в беззвучный режим, выключите телевизор и начните.

Во время моей инженерии мой учитель каждый раз говорил, что нужно больше фокусироваться на основах, потому что именно они укрепят вашу базу по любому предмету, который вы читаете, поэтому здесь я прежде всего дам вам основную информацию о контролируемом обучении, обучении без учителя и тогда я открою дверь знаний о Генеративных моделях для всех вас, чтобы погрузиться в них.

Контролируемое обучениена сегодняшний день является наиболее доминирующей формой глубокого обучения сегодня, с широким спектром применения в промышленности. При контролируемом обучении у вас есть входная переменная (x) и выходная переменная (Y), и вы используете алгоритм для изучения функции отображения от входа к выходу.

Цель состоит в том, чтобы аппроксимировать функцию отображения так, чтобы при наличии новых входных данных (x) вы могли предсказать выходную переменную (Y) для этих данных.

Как правило, почти все приложения глубокого обучения, которые в настоящее время находятся в центре внимания, относятся к этой категории, такие как оптическое распознавание символов, распознавание речи, классификация изображений и языковой перевод.

* Раздел информации *: Если вы хотите увидеть, как с помощью tenorflow я сделал классификатор продуктов питания, просто нажмите на этоссылкаВо всяком случае, посмотрите видео для большей ясности.

Хотя контролируемое обучение в основном состоит из классификации и регрессии, есть и другие привлекательные варианты, включая следующие:

Уменьшение размерностиа такжекластеризацияЭто очень известные категории обучения без учителя, прочитайте о них, перейдя по ссылкам, чтобы укрепить ваше понимание этой области машинного обучения.

Для обучения генеративной модели мы сначала собираем большой объем данных в некоторой области (например, думаем о миллионах изображений, предложений или звуков и т. Д.), А затем обучаем модель генерировать подобные данные.

Хитрость заключается в том, что нейронные сети, которые мы используем в качестве генеративных моделей, имеют ряд параметров, значительно меньших, чем объем данных, на которых мы их обучаем, поэтому модели вынуждены обнаруживать и эффективно усваивать сущность данных для их генерации.

Генеративные модели имеют много краткосрочных приложений. Но в конечном итоге они обладают потенциалом для автоматического изучения естественных особенностей набора данных, будь то категории или измерения или что-то еще полностью.

Хорошо, что много литературы, давайте теперь немного поговорим о формализме.

Принципиальная разница между Dдискриминационные моделии Gобразные моделиявляется:

Дискриминационные моделиизучать(жесткая или мягкая) границамежду классами

Генеративные моделисмоделироватьраспределениеиндивидуальных занятий

например, генеративных моделей

примеры дискриминационных моделей:

Проще говоря: Gдоходная модельмодель условной вероятности наблюдаемойИксзаданная цель y, символически, P (X | Y = y), в то время как Dдискриминационная модельмодель условной вероятности целиYпри условии наблюдения x символически P (Y | X = x).

Итак, все основные аспекты, все технические термины объяснены, теперь пришло время обратить ваше внимание на применение Генеративных моделей и задуматься, как ИИ будет и помогает нам «Людям» быть более креативными.

Я знаю, что вы, наверное, догадаетесь, что теперь, как и все остальные, этот автор тоже расскажет о неявных моделях, таких какГенеративные состязательные сети(Gans)и явные глубокие авторегрессионные модели, такие какPixelCNNили даже он мог бы также объяснить глубоко скрытые переменные модели, такие какВариационные АвтоЭнкодерыНо вы все не правы, поэтому просто расслабьтесь, успокойте свой мозг и наслаждайтесь тем, что вы собираетесь прочитать.

Теперь, в последней части этого поста, я познакомлю вас всех с проектом «фуксин»,фуксинЭто исследовательский проект, исследующий роль машинного обучения в процессе создания искусства и музыки.

В первую очередь это связано с разработкой новых алгоритмов глубокого обучения и подкрепления для создания песен, изображений, рисунков и других материалов. Но это также исследование создания интеллектуальных инструментов и интерфейсов, которые позволяют художникам и музыкантам расширять (а не заменять!) Свои процессы, используя эти модели. Пурпурный был создан некоторыми исследователями и инженерами изКоманда Google Brainно многие другие внесли значительный вклад в проект.

Итак, первая модель, которая является моей личной любимойЭскиз-РННГенеративная модель для векторных рисунков, которая представляет собой рекуррентную нейронную сеть (RNN), способную создавать основанные на штрихах рисунки общих объектов. Модель обучена на наборе данных нарисованных человеком изображений, представляющих много различных классов. Автор очерчивает структуру для создания условных и безусловных эскизов и описывает новые надежные методы обучения для генерации последовательных эскизов в векторном формате.

В демо-версии справа ниже посмотрите на позы йоги, порожденные перемещением через выученное представление (скрытое пространство) модели, обученной на рисунках йоги. Обратите внимание, как он запутывается примерно через 10 секунд, когда он движется от поз, стоящих к позам, выполненным на коврике для йоги.

Вторая модель посвящена меломану по имениMusicVAE.Когда художник создает произведение искусства, он сначала смешивает и исследует варианты цвета в палитре художника, а затем применяет их к холсту. Этот процесс сам по себе является творческим актом и оказывает глубокое влияние на окончательную работу.

Музыканты и композиторы в основном испытывали недостаток в подобном устройстве для исследования и микширования музыкальных идей, но теперь MusicVAE, который является моделью машинного обучения, позволяет им создавать палитры для смешивания и исследования музыкальных партитур. Демо прямо там внизу

Я выставил всех вас только двум из множества моделей, которые были построены в рамках проектафуксини к этому времени вы все должны были испытать, как ИИ может помочь нам в расширении, не заменяя наш творческий процесс. Чтобы узнать больше об этих порождающих моделях, изучите указатели в справочном разделе.

Спасибо за внимание

Вы используетевашвремя читатьмойработа значит мир для меня. Я полностью это имею в виду.

Если вам понравилась эта история, сходите с ума отаплодируют (👏)кнопка! Это поможет другим людям найти мою работу.

Кроме того, следуйте за мной на Medium, LinkedIn или Twitter, если хотите! Мне бы понравилось это.

Введение в Генеративно-состязательные сети (GAN – Genereative Adversarial Networks)

Генеративно-состязательные сети, или сокращенно GAN, представляют собой подход к генеративному моделированию с использованием методов глубокого обучения, таких как сверточные нейронные сети.

Генеративное моделирование – это задача машинного обучения без учителя (неконтролируемое обучение), которая заключается в автоматическом обнаружении закономерностей и зависимостей во входных данных, которые можно было бы использовать для генерации на выходе новых примеров, которые могли бы быть непротиворечиво/правдоподобно присутствовать в оригинальном (исходном) наборе данных.

GAN представляют собой нетривиальный способ обучения генеративной модели, сводящий задачу к контролируемому процессу обучения (обучение с учителем), и состоящий из двух под-моделей: модели генератора, которую мы обучаем генерировать новые примеры, и модели дискриминатора, которая пытается классифицировать примеры как реальные (из реального источника) или поддельные (сгенерированные). Две модели обучаются вместе в игре с нулевой суммой (антагонистической игре), состязательной, до тех пор, пока модель дискриминатора не начнет обманываться примерно в половине случаев, что означает, что модель генератора генерирует правдоподобные примеры.

GAN представляют собой захватывающую и быстро меняющуюся область, которая обещает создание генеративных моделей со способностью создавать реалистичные примеры для целого ряда проблемных областей, особенно в таких задачах обработки изображений, как перевод изображений из летних в зимние или изо дня в ночь, а также в создании реалистичных фотографий объектов, сцен и людей, которые люди не могут отличить от поддельных.

В этом посте вы познакомитесь с кратким введением в Генеративно-состязательные сети, или GAN.

В частности, вы узнаете:

Содержание

Этот пост состоит из трех частей:

Какие бывают генерирующие Модели?

В этом разделе мы рассмотрим идею генеративных моделей, рассмотрев парадигмы обучения с учителем и без, а также дискриминационное моделирование против генеративного.

Обучение с учителем против обучения без учителя

Типичная проблема машинного обучения включает в себя использование модели для прогнозирования, например прогнозирующее моделирование.

Для этого требуется обучающий набор данных, который используется для обучения модели, состоящей из нескольких примеров, называемых выборками, каждая из которых содержит входные переменные (X) и выходные метки класса (y). Модель обучается на примерах входных данных, делая прогнозы выходных данных и последующей корректировки модели, чтобы сделать выходные данные более похожими на ожидаемые.

В подходе прогнозирующего или контролируемого обучения цель состоит в том, чтобы выучить модель делать отображение входящих данных x в выходящие значения y, учитывая имеющийся набор пар ввода-вывода…

Такое моделирование обычно называют контролируемой формой обучения или обучением с учителем.

Пример контролируемого обучения

Примеры контролируемых задач обучения включают классификацию и регрессию, а примерами алгоритмов контролируемого обучения являются логистическая регрессия и случайный лес.

Существует еще одна парадигма обучения, когда модели задаются только входные переменные (X), и задача не содержит выходных значений (y).

Модель строится путем извлечения или суммирования шаблонов, основанных на входных данных. Корректировка модели отсутствует, так как модель ничего не прогнозирует.

Вторым основным типом машинного обучения является описательный или неконтролируемый подход к обучению. Здесь нам дают только входные данные, и цель состоит в том, чтобы найти «закономерности» в данных. […] Это гораздо менее четко определенная задача, так как нам не говорят, какие шаблоны искать, и нет очевидной метрики ошибки, которую следует использовать (в отличие от контролируемого обучения, где мы можем сравнить наш прогноз у для данных х с наблюдаемой величиной).

Такое отсутствие коррекции обычно называют неконтролируемой формой обучения или обучением без учителя.

Пример обучения без учителя

Примерами неконтролируемых задач обучения являются кластеризация и генеративное моделирование, а примерами неконтролируемых алгоритмов обучения являются K-means и генерирующие состязательные сети.

Дискриминационное и генеративное моделирование

В контролируемом обучении нас часто интересует разработка модели для прогнозирования метки класса на примере входных переменных.

Такая задача прогнозирующего моделирования называется классификацией.

Классификация также традиционно называется дискриминационным моделированием.

… Мы используем данные обучения, чтобы найти дискриминантную функцию f(x), которая отображает каждый элемент x непосредственно в метку класса, тем самым объединяя этапы вывода и принятия решения в одну задачу обучения.

Именно потому, что модель должна разделить входные переменные по классам; она должна выбрать или принять решение относительно того, к какому классу относится конкретный пример.

Пример дискриминационного моделирования

С другой стороны, неконтролируемые модели, которые суммируют распределение входных переменных, могут быть использованы для создания или генерации новых примеров во входном распределении.

Пример генеративного моделирования

Например, одна переменная может иметь известное распределение данных, такое как распределение Гаусса. Генеративная модель должна быть в состоянии проанализировать это распределение данных, а затем использовать его для генерации новых переменных, которые правдоподобно вписываются в распределение входной переменной.

Подходы, которые явно или неявно моделируют распределение входных данных, а также выходных данных, известны как генеративные модели, поскольку путем выборки из них можно генерировать синтетические точки в пространстве вводных данных.

Фактически, действительно хорошая генеративная модель может генерировать новые примеры, которые не просто правдоподобны, а неотличимы от реальных примеров из области входных данных.

Примеры генеративных моделей

Наивный Байес – пример генеративной модели, которая часто используется в качестве дискриминационной модели.

Например, Наивный Байес работает, суммируя распределение вероятностей каждой входной переменной и выходного класса. Когда делается прогноз, вероятность для каждого возможного результата вычисляется для каждой переменной, независимые вероятности объединяются, и наиболее вероятный результат является прогнозом. При обратном использовании, распределения вероятностей для каждой переменной могут быть выбраны для создания новых вероятных (независимых) значений признаков.

Другие примеры генеративных моделей включают в себя скрытое распределение Дирихле или LDA и модель гауссовой смеси или GMM.

Методы глубокого обучения могут быть использованы в качестве генеративных моделей. Два популярных примера включают ограниченную машину Больцмана, или RBM, и Deep Belief Network, или DBN.

Два современных примера алгоритмов генеративного моделирования глубокого обучения включают в себя Variational Autoencoder, или VAE, и Generative Adversarial Network, или GAN.

Что такое Генерирующие Состязательные Сети?

Генерирующие Состязательные Сети, или GAN, являются основанной на глубоком обучении генеративной моделью.

В более общем смысле, GAN являются модельной архитектурой для обучения генеративной модели, и в этой архитектуре чаще всего используются модели глубокого обучения.

Стандартный подход под названием «Глубокие сверточные генеративно-состязательные сети», или DCGAN, который привел к более стабильным моделям, был впоследствии формализован Алеком Рэдфордом и соавт. в работе 2015 года под названием «Обучение репрезентативной выборки с использованием неконтролируемых генериративно-состязательных сетей».

Большинство современных GAN в определенной степени основаны на архитектуре DCGAN …

Архитектура модели GAN включает две под-модели: модель генератора для создания новых примеров и модель дискриминатора для классификации того, являются ли сгенерированные примеры реальными, из области исходных данных или поддельными, сгенерированными генеративной моделью.

Генеративно-состязательные сети основаны на теоретико-игровом сценарии, в котором генерирующая сеть должна конкурировать с противником. Генеративная сеть производит образцы. Его противник, сеть дискриминатора, пытается различить выборки, взятые из обучающих данных, и выборки, взятые из генератора.

Модель генератора

Модель генератора принимает случайный вектор фиксированной длины в качестве входных данных и генерирует выборку.

Вектор взят случайным образом из гауссовского распределения, и он используется для начального процесса генерации. После обучения, точки в этом многомерном векторном пространстве будут соответствовать точкам в исходной области, образуя сжатое представление распределения данных.

Латентная переменная – это случайная переменная, которую мы не можем наблюдать непосредственно.

Мы часто называем скрытые переменные или скрытое пространство проекцией или сжатым распределением данных. То есть, скрытое пространство обеспечивает сжатие. В случае GAN модель генератора выбирает значение из точек в скрытом пространстве так, что новые точки, взятые из скрытого пространства, могут быть предоставлены модели генератора в качестве входных данных и использованы для генерации новых и различных выходных примеров.

Модели машинного обучения могут изучать статистическое скрытое пространство изображений, музыки и историй, а затем они могут использовать эти пространства, создавая новые произведения искусства с характеристиками, подобными тем, которые модель видела в своих данных при обучении.

После обучения модель генератора сохраняется и используется для генерации новых примеров.

Пример модели генератора GAN

Модель Дискриминатора

Модель дискриминатора берет пример из области входных данных (действительный или сгенерированный) и предсказывает двоичную метку класса реального или поддельного (сгенерированного).

Реальный пример берется из учебного набора данных. Сгенерированные примеры выводятся моделью генератора.

Дискриминатор – это нормальная (и хорошо понятная) классификационная модель.

После процесса обучения модель дискриминатора отбрасывается, поскольку мы заинтересованы в генераторе.

Иногда генератор можно изменить, поскольку он научился эффективно извлекать примеры из данных исходной области. Некоторые или все слои модели для извлечения признаков могут использоваться в приложениях с использованием таких же или аналогичных входных данных.

Предполагается, что один из лучших способов обработки изображений – это обучение Генеративно-состязательных сетей (GAN) и последующее повторное использование части обученной сети генераторов и дискриминаторов в качестве экстракторов функций для других контролируемых задач.

Пример модели дискриминатора GAN

GAN как игра для двух игроков

Как мы уже говорили в предыдущем разделе, генеративное моделирование является неконтролируемой проблемой обучения, хотя одним из уникальных свойств архитектуры GAN является то, что обучение генеративной модели преобразуется в контролируемую задачу обучения.

Две модели, генератор и дискриминатор, обучаются вместе. Генератор генерирует серию выборок, и они, наряду с реальными примерами из исходной области, предоставляются дискриминатору, который классифицирует их как реальные или поддельные.

Затем дискриминатор обновляется, чтобы улучшить распознавание реальных и поддельных выборок в следующем раунде, и, что важно, генератор обновляется на основе того, насколько хорошо или нет сгенерированные выборки обманули дискриминатор.

Мы можем думать о генераторе как о фальшивомонетчике, пытающемся создать фальшивые деньги, а о дискриминаторе как о полицейском, пытающемся принять законные деньги и поймать фальшивые. Чтобы добиться успеха в этой игре, фальшивомонетчик должен научиться производить деньги, которые неотличимы от настоящих денег, а сеть генераторов должна научиться создавать выборки, взятые из того же распределения, что и данные обучения.

Таким образом, две модели конкурируют друг с другом, они соперничают в смысле теории игр и играют в игру с нулевой суммой (антагонистическая игра).

Поскольку инфраструктуру GAN можно естественно проанализировать с помощью инструментов теории игр, мы называем GAN «состязательными».

В этом случае нулевая сумма означает, что, когда дискриминатор успешно идентифицирует реальные и поддельные выборки, он вознаграждается или не требуется никаких изменений для параметров модели, тогда как генератор штрафуется большими обновлениями параметров модели.

С другой стороны, когда генератор вводит в заблуждение дискриминатор, он вознаграждается, или не требует никаких изменений параметров модели, а вот дискриминатор штрафуется, и его параметры модели обновляются.

В конце генератор каждый раз создает точные реплики из входной области, а дискриминатор не может определить разницу и предсказывает «неуверенно» (например, 50% для реального и поддельного) в каждом случае. Это просто пример идеализированного случая; нам не нужно добираться до этой точки, чтобы прийти к полезной модели генератора.

Пример архитектуры модели Генеративно-состязательной сети

[обучение] заставляет дискриминатор попытаться научиться правильно классифицировать образцы как реальные или поддельные. Одновременно генератор пытается обмануть классификатор, представляя, что его образцы реальны. При конвергенции выборки генератора неотличимы от реальных данных, и дискриминатор всегда выдает 1/2. Затем дискриминатор может быть отброшен.

GAN и сверточные нейронные сети

GAN обычно работают с данными изображений и используют сверточные нейронные сети или CNN в качестве моделей генератора и дискриминатора.

Причиной этого может быть то, что первое описание метода было сделано в области компьютерного зрения и использовало CNN и данные изображений, а также из-за существенного прогресса, который был достигнут в последние годы в более широком использовании CNN – например, современные результаты в отношении набора задач компьютерного зрения, таких как обнаружение объектов и распознавание лиц.

Данные моделирования изображений означают, что скрытое пространство, входное значение для генератора, обеспечивает сжатое представление набора изображений или фотографий, используемых для обучения модели. Это также означает, что генератор создает новые изображения или фотографии, обеспечивая вывод, который может быть легко просмотрен и оценен разработчиками или пользователями модели.

Возможно, именно этот факт превосходит другие, способность визуально оценивать качество генерируемых данных, что привело как к фокусу на приложениях компьютерного зрения с CNN, так и к существенным достижениям GAN по сравнению с другими генеративными моделями.

Условные GAN

Важным расширением GAN является их использование для условного генерирования выходных данных.

Генеративная модель может быть обучена генерировать новые примеры из области ввода, где ввод, случайный вектор из скрытого пространства, обеспечивается (обусловлен) некоторым дополнительным вводом.

Дополнительным вводом может быть значение класса, например, мужчина или женщина при создании фотографий людей, или цифра, в случае создания изображений рукописных цифр.

Генеративные состязательные сети могут быть расширены до условной модели, если и генератор, и дискриминатор обусловлены некоторой дополнительной информацией y. y может быть любой вспомогательной информацией, такой как метки классов или данные из других областей. Мы можем выполнить условие, подав y в дискриминатор и генератор как дополнительный входной слой.

Дискриминатор также становится условным, что означает, что он снабжен как реальным или фальшивым входным изображением, так и дополнительным вводом. В случае условного ввода типа метки классификации дискриминатор будет ожидать, что этот ввод будет принадлежать этому классу, в свою очередь обучая генератор генерировать примеры этого класса, чтобы обмануть дискриминатор.

Таким образом, условная GAN может использоваться для генерации примеров из области данного типа.

Если сделать еще один шаг вперед, модели GAN могут стать условными на примере изображений. Это позволит создать такие приложения GAN, как перевод текста в изображение или перевод изображения в другое изображение. Это позволяет использовать некоторые из наиболее впечатляющих приложений GAN, таких как передача стилей, цветопередача фотографий, преобразование фотографий из лета в зиму или изо дня в ночь и т. д.

В случае условных GAN для преобразования изображения в изображение, таких как преобразование дня в ночь, дискриминатор предоставляет примеры реальных и сгенерированных ночных фотографий, а также (обусловленных) реальных дневных фотографий в качестве входных данных. Генератор снабжен случайным вектором из скрытого пространства, а также (обусловленными) реальными дневными фотографиями в качестве входных данных.

Пример условной архитектуры модели Генериративно-состязательной сети

Зачем нужны Генеративно-состязательные сети?

Увеличение данных приводит к получению более эффективных моделей, что увеличивает навыки модели и обеспечивает эффект регуляризации, уменьшая ошибку обобщения. Он работает, создавая новые, искусственные, но правдоподобные примеры из входной области данных, на которой обучается модель.

Методы являются примитивными в случае данных изображений, включая кадрирование, сальто, масштабирование и другие простые преобразования существующих изображений в наборе обучающих данных.

Успешное генеративное моделирование обеспечивает альтернативный и потенциально более предметно-ориентированный подход для увеличения данных. Фактически, увеличение данных – это упрощенная версия генеративного моделирования, хотя это редко описывается таким образом.

… Увеличение выборки скрытыми (ненаблюдаемыми) данными. Это называется увеличением данных. […] В других задачах скрытые данные являются фактическими данными, которые могли бы наблюдаться, но отсутствуют.

В сложных областях или областях с ограниченным объемом данных генеративное моделирование это лучший путь подготовиться к моделированию. В этом случае GAN добились большого успеха в таких областях, как глубокое обучение с подкреплением.

Существует много причин, по которым GAN интересны, важны и требуют дальнейшего изучения. Ян Гудфеллоу описывает некоторые из них в своей основной конференции и связанном с ней техническом отчете 2016 года под названием « Учебное пособие по NIPS 2016: Генерирующие состязательные сети ».

Среди этих причин он выделяет успешную способность GAN моделировать многомерные данные, обрабатывать недостающие данные и способность GAN предоставлять много-модальные выходы или множественные правдоподобные ответы.

Возможно, наиболее веская причина того, что GAN широко изучаются, разрабатываются и используются, заключается в их успехе. GAN смогли сгенерировать фотографии настолько реалистичные, что люди не могут распознать, что они представляют собой объекты, сцены и людей, которых не существует в реальной жизни.

Можно сказать, что “удивительные” не является достаточным прилагательным для характеристики их способности и успеха.

Дальнейшее чтение

Этот раздел предлагает больше ресурсов по теме, если вы хотите изучить ее более подробно.

Posts

Books

Papers

Articles

Резюме

В этом посте вы ознакомились с кратким введением в Генериративно-состязательные сети, или GAN.